Qualité des données et Solvabilité II : faire de l’exigence réglementaire un cadre d’action et de transformation

Depuis l’entrée en vigueur en janvier 2016 de Solvabilité II, la qualité des données est devenue un pilier incontournable de la conformité prudentielle des organismes d’assurance. Longtemps perçue comme un sujet essentiellement technique, elle s’impose aujourd’hui comme un véritable enjeu stratégique, à la croisée des problématiques de gouvernance, de pilotage des risques et de performance opérationnelle.

La publication par l’ACPR de sa notice sur la qualité des données en décembre 2023 a marqué un tournant. Elle renforce clairement les attentes du superviseur en matière d’appropriation des processus, de traçabilité et de gouvernance, tout en rappelant que la responsabilité de la qualité des données ne peut plus reposer uniquement sur les équipes IT ou actuarielle.

« Dans un contexte de contrôles accrus et de reporting réglementaire toujours plus exigeant, la question n’est donc plus seulement de savoir si les données sont « justes », mais si l’organisation est capable de démontrer, à tout moment, leur fiabilité, leur origine et leur adéquation aux usages prudentiels

La qualité des données : une exigence explicite de Solvabilité II

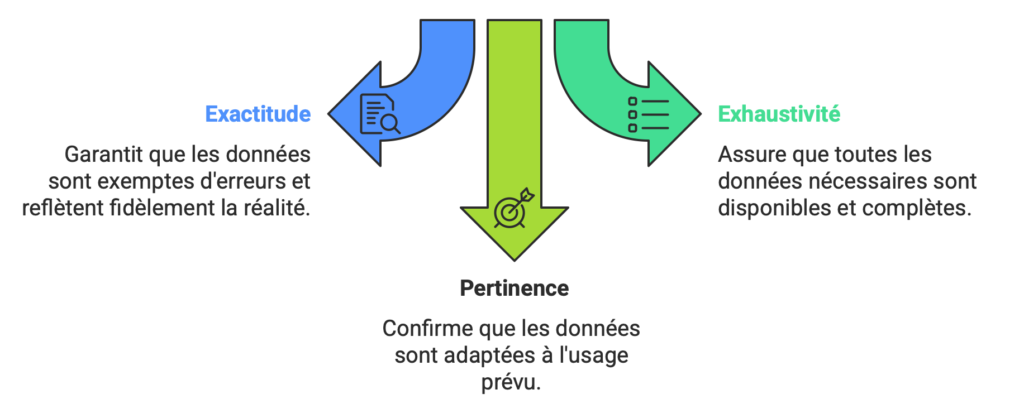

La Qualité des Données (QDD) désigne l’ensemble des principes, méthodes et pratiques visant à garantir que les données utilisées sont fiables, complètes, cohérentes et adaptées à leur usage. Dans le cadre de Solvabilité II, ces exigences concernent aussi bien les données internes issues des systèmes de gestion, comptables ou actuariels, que les données externes (tables de mortalité, notations financières, études de marché, etc.).

Gouvernance de la donnée : le socle de toute démarche QDD

La notice ACPR rappelle explicitement l’importance de disposer d’un dictionnaire de données structuré, couvrant l’ensemble des données utilisées dans les dispositifs prudentiels. Pourtant, ce sujet reste souvent perçu comme lourd, chronophage, et difficile à maintenir dans la durée.

Un dictionnaire de données efficace ne se limite pas à une liste de champs techniques. Il doit permettre de répondre à des questions essentielles :

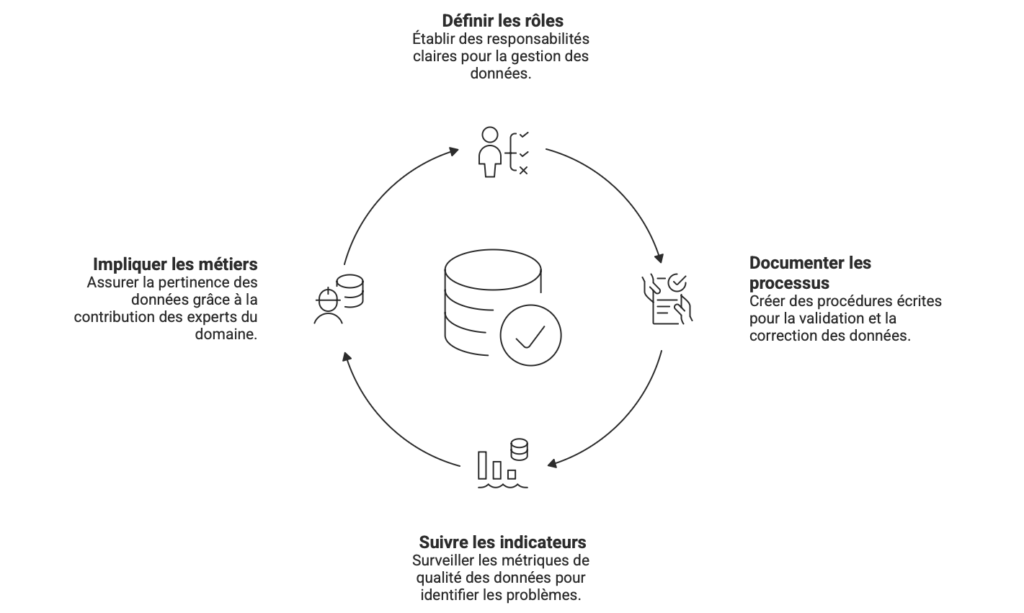

— 01

Rôles définis

Data owner, data steward, référents métiers, fonctions risques, IT — chacun avec un périmètre clair.

— 02

Processus documentés

Validation, escalade et correction des anomalies formalisées et appliquées au quotidien.

— 03

Instances de pilotage

Comités data permettant de suivre les indicateurs de qualité et d’arbitrer les priorités.

— 04

Implication des métiers

Les métiers garants de la pertinence des données par rapport à leurs usages réels.

Dans la pratique, de nombreuses organisations disposent de politiques QDD formelles, mais peinent à les décliner de manière opérationnelle et transverse. Les responsabilités restent parfois théoriques, les processus peu appliqués, et les indicateurs de qualité insuffisamment exploités.

Traçabilité des données : un enjeu clé en cas de contrôle

Dans le cadre de Solvabilité II, la capacité à démontrer l’origine et le parcours d’une donnée est aussi importante que la donnée elle-même. La traçabilité implique de pouvoir reconstituer l’ensemble de la chaîne de traitement : sources, transformations, outils, contrôles, et responsables à chaque étape.

Cette exigence est particulièrement critique pour les calculs de provisions techniques, la production des QRT ainsi que les différents reportings (ORSA, SFCR et RSR).

Or, dans de nombreuses organisations, la traçabilité reste fragilisée par :

des chaînes de traitement complexes

des flux peu ou mal documentés

des retraitements manuels, souvent réalisés sous Excel

des dépendances fortes à des connaissances individuelles

Ces pratiques introduisent des risques élevés : erreurs non détectées, absence de justification en cas de revue ACPR, difficulté à sécuriser les délais de production.

De la cartographie des flux à la sécurisation des traitements

Pour répondre à ces enjeux, la première étape consiste à disposer d’une cartographie claire des flux de données, reliant les systèmes sources aux usages réglementaires.

Cette cartographie constitue un levier majeur pour améliorer la traçabilité, mais aussi pour fiabiliser les délais de production et réduire la dépendance aux traitements exceptionnels.

C’est pour cela qu’un accompagnement peut être nécessaire afin de :

Cartographier les flux amont-aval des données utilisées dans les calculs prudentiels

Identifier les zones à risque liées aux traitements manuels ou aux ruptures de chaîne

Documenter les règles de transformation et d’agrégation

Proposer des actions de sécurisation des processus critiques

Dictionnaire de données : de l’obligation réglementaire au levier de pilotage

La notice ACPR rappelle explicitement l’importance de disposer d’un dictionnaire de données structuré, couvrant l’ensemble des données utilisées dans les dispositifs prudentiels. Pourtant, ce sujet reste souvent perçu comme lourd, chronophage, et difficile à maintenir dans la durée.

Un dictionnaire de données efficace ne se limite pas à une liste de champs techniques. Il doit permettre de répondre à des questions essentielles :

— 01

Que représente exactement cette donnée ?

— 02

À quoi sert-elle ?

— 03

Qui en est responsable ?

— 04

Où est-elle utilisée dans les calculs et reportings ?

Sans cette compréhension partagée, les écarts d’interprétation se multiplient entre équipes métiers, actuarielles, IT et risques, générant incohérences, corrections tardives et incompréhensions lors des contrôles.

Construire un dictionnaire vivant et utile

L’enjeu n’est donc pas seulement de produire un dictionnaire, mais de l’intégrer pleinement dans la gouvernance de la donnée.

Les organismes d’assurance peuvent bénéficier d’un accompagnement sur l’identification des données clés utilisées dans les QRT, ORSA, SCR/MCR, la structuration d’un référentiel partagé métier / IT / réglementaire, la mise en place de processus de mise à jour et de validation et l’intégration du dictionnaire dans les circuits de gouvernance existants.

Co-construit avec les équipes internes, le dictionnaire devient alors un outil de référence opérationnel, facilitant la compréhension, la fiabilisation des traitements et la communication avec le superviseur.

Qualité des données : bien plus qu’un sujet de conformité

Si la qualité des données est une exigence réglementaire forte, elle constitue aussi un véritable levier de transformation pour les organismes d’assurance.

Un dispositif QDD robuste permet notamment :

D’améliorer la fiabilité des indicateurs de pilotage

De réduire les risques opérationnels

De sécuriser les délais de production réglementaire

De préparer les organisations à des projets data plus avancés (automatisation, analytics, IA)

Dans un contexte où l’industrialisation des usages et notamment le déploiement d’agents IA, repose largement sur la fiabilité et la structuration des données, la qualité de ces dernières devient un prérequis indispensable. Des données cohérentes, accessibles et gouvernées constituent en effet un socle stratégique pour automatiser les processus, fiabiliser les analyses et accélérer l’innovation. À l’inverse, une mauvaise maîtrise de la donnée freine les initiatives de modernisation et renforce la dépendance aux traitements manuels, au détriment de la performance globale.

SK WILLING, partenaire de votre transformation QDD

Dans un environnement réglementaire de plus en plus exigeant, SK WILLING se positionne comme un partenaire de confiance pour accompagner les organismes d’assurance dans la structuration durable de leur dispositif de qualité des données.

Notre approche repose sur plusieurs leviers complémentaires :

Audit du dispositif QDD et diagnostic de conformité par rapport aux exigences ACPR

Mise en place ou renforcement de la gouvernance de la donnée

Cartographie des flux et sécurisation des chaînes de traitement

Construction et outillage du dictionnaire de données

Formation et acculturation des équipes pour garantir l’appropriation dans la durée

En s’appuyant sur une méthodologie opérationnelle et une forte expérience terrain, nos équipes accompagnent la mise en conformité tout en créant les conditions d’une meilleure performance data à long terme.

Transformer la contrainte réglementaire en levier de valeur

La qualité des données n’est plus un simple prérequis réglementaire : elle devient un facteur clé de robustesse, d’agilité et de crédibilité pour les organismes d’assurance.

En structurant la gouvernance, en sécurisant les flux et en partageant une compréhension commune des données, les organisations renforcent leur capacité à piloter les risques, à anticiper les évolutions réglementaires et à engager des transformations data plus ambitieuses.

Chez SK WILLING, nous sommes convaincus que la QDD peut devenir un véritable levier de création de valeur, à condition d’être pensée comme un projet transverse, stratégique et durable.

Pour en savoir plus, n’hésitez pas à nous contacter.

Nous contacter